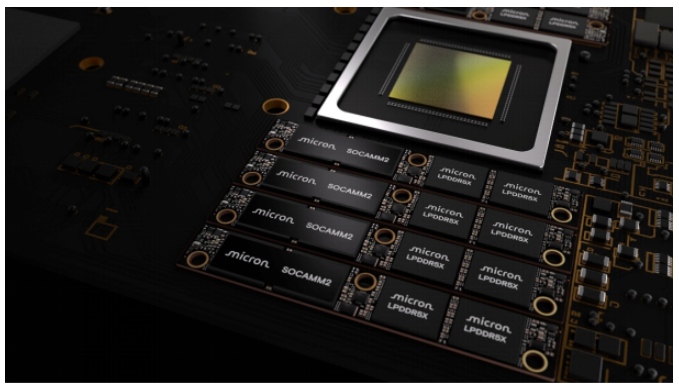

2026年3月5日,美国爱达荷州博伊西市 - 全球存储技术领导者美光科技宣布,已开始向客户提供业界容量领先的256GB SOCAMM2 LPDRAM模块样品。这一采用业界首创单晶粒32Gb LPDDR5X技术的产品,标志着AI数据中心基础架构即将迎来重大变革。

。 Xilinx总代理近期参与了Xilinx原厂举办的年度技术峰会,第一时间掌握了下一代网络芯片的技术路线图。作为授权渠道,我们将优先获得新品样片和开发板,为客户提供最新的产品资讯。

。 Xilinx总代理近期参与了Xilinx原厂举办的年度技术峰会,第一时间掌握了下一代网络芯片的技术路线图。作为授权渠道,我们将优先获得新品样片和开发板,为客户提供最新的产品资讯。

随着AI训练、推理、代理式AI和通用计算的深度融合,现代工作负载对内存提出了前所未有的挑战。大模型参数规模不断扩大,上下文窗口持续扩展,持久性键值(KV)缓存需求激增,同时核心计算对数据强度、并发性和内存空间的要求也日益提高。内存容量、带宽效率、延迟和能效已成为系统层面的关键瓶颈。

针对上述挑战,LPDRAM凭借其独特的性能优势,在功耗与散热限制日益严苛的数据中心环境中,成为AI及核心计算服务器的理想选择。美光正与NVIDIA紧密合作,共同设计下一代高性能内存解决方案,以满足先进AI基础架构的需求。

"美光256GB SOCAMM2为AI及高性能计算提供了更具能效的CPU附加内存解决方案,"美光高级副总裁暨云端存储事业部总经理Raj Narasimhan表示,"此次产品发布充分展现了我们在技术与封装领域的突破,打造了业界容量领先、低功耗、小尺寸的模块化内存解决方案。"

该新产品专为容量、能效和工作负载性能优化而设计,为各种AI和通用计算工作负载提供了显著提升:

内存容量扩展:256GB SOCAMM2较前代192GB版本提升33%,为每颗8通道CPU提供高达2TB的LPDRAM容量,支持更大上下文窗口和更复杂的推理工作负载。

能效与空间优化:与同等容量RDIMM相比,SOCAMM2功耗降至1/3,尺寸缩小至1/3,有效提高机架密度并降低总体拥有成本。

性能飞跃:在统一内存架构中,用于KV缓存卸载时,可将长上下文、实时LLM推理的首个token生成时间加速2.3倍。在独立CPU应用中,每瓦性能提升超3倍。

模块化设计:模块化SOCAMM2设计提升了设备可维护性,支持液冷服务器架构,并可根据未来AI与核心计算内存需求增长实现容量扩充。

NVIDIA数据中心CPU产品部门主管Ian Finder对此表示:"先进AI基础架构需要在各个层面进行极致优化,才能有效应对严苛的AI推理工作负载。美光256GB SOCAMM2以低于传统服务器内存的功耗,实现了超大内存容量与带宽的突破,为下一代AI CPU提供了关键助力。"

作为JEDEC SOCAMM2规范制定过程中的领导者,美光持续与系统设计人员保持深度技术合作,推动下一代数据中心平台在能效与性能方面的全行业提升。目前,美光已面向客户送样256GB SOCAMM2产品,并提供了业界最全面的数据中心LPDRAM产品组合,涵盖8GB至64GB组件及48GB至256GB的SOCAMM2模块,满足不同应用场景的需求。

我们作为Xilinx中国代理的指定供应中心,深耕电子元器件领域多年,拥有原厂一级供货渠道。我们不仅提供100%%原装正品的Xilinx全系列芯片,更为客户提供从选型指导到技术支持的全链条服务。无论是工业控制、网络通信还是消费电子,我们都能为您匹配最优解决方案。选择我们,就是选择专业与信赖。

我们与Xilinx建立了长期稳定的战略合作关系,享有优先供货权和最优惠的价格支持。我们的技术团队平均从业经验超过8年,能够快速响应您的设计需求,提供从样品到量产的一站式服务。无论订单大小,我们都以同样的专业态度对待每一位客户。